13 октября, Минск /Корр. БЕЛТА/. Некоторые лидеры технологической отрасли покупают участки земли с подземными помещениями для преобразования их в роскошные бункеры. Об этом говорится в материале BBC.

Авторы публикации отмечают, что, возможно, техномиллиардеры таким образом готовятся к какому-то "катастрофическому событию", которое в том числе может быть спровоцировано стремительным развитием технологий искусственного интеллекта (ИИ).

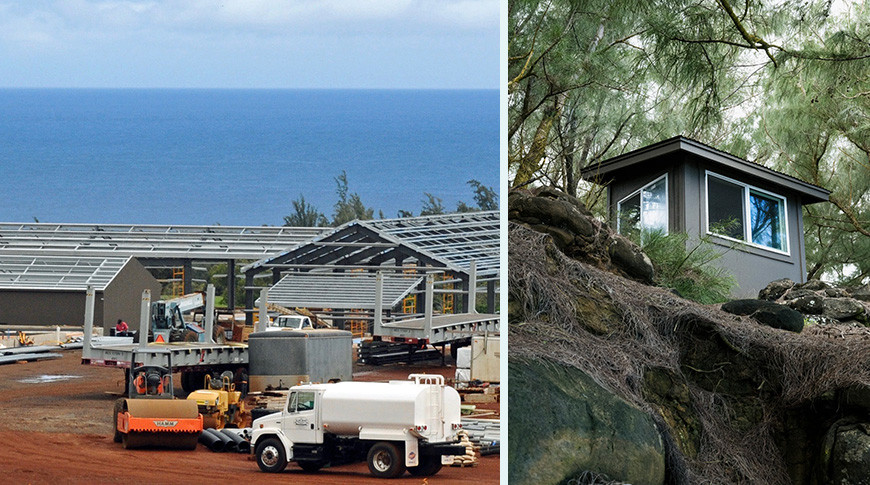

В пример приводится IT-предприниматель Марк Цукерберг, который в 2014 году начал возводить жилой комплекс Koolau Ranch на гавайском острове Кауаи. Согласно журналу Wired, новый дом включает в себя убежище с собственными источниками энергии и запасами продовольствия, при этом строители, работающие на объекте, обязались не разглашать информацию об этом. Когда Цукерберга спросили, строит ли он бункер на случай конца света, он ответил, что это - "просто небольшое убежище, похожее на подвал". Затем он принял решение купить 11 объектов недвижимости в районе Кресент-Парк в Калифорнии, под которыми, по-видимому, находится подземное пространство площадью в 650 кв.м. По данным New York Times, некоторые из его соседей называют сооружение бункером или пещерой миллиардера.

Рид Хоффман, соучредитель LinkedIn, упоминал о тенденции, которую он назвал "страховкой от апокалипсиса". По его словам, около половины сверхбогатых людей на планете имеют такую страховку, а популярное место для приобретения таких домов - Новая Зеландия.

Илья Суцкевер, исследователь ИИ и соучредитель Open AI, на одном из совещаний предложил коллегам выкопать подземное убежище для ведущих ученых компании до того, как такая мощная технология, как ИИ, будет выпущена в мир. Он отмечал, что IT-специалисты находятся на грани разработки общего искусственного интеллекта (ОИИ) - момента, когда машины сравняются с человеческим интеллектом, и это таит в себе много опасностей.

Парадокс, как отмечает BBC, заключается в том, что многие ведущие IT-специалисты сейчас усердно работают над разработкой чрезвычайно интеллектуальной формы ИИ, но также они глубоко опасаются того, что к чему это однажды может привести человечество. В частности, ОИИ может оказаться настолько революционной технологией, что обычные люди начнут ее бояться.

Лидеры технологической отрасли заявляют, что появление ОИИ не за горами. В декабре 2024 года глава OpenAI Сэм Альтман сделал прогноз, что это произойдет "раньше, чем думает большинство людей в мире". Демис Хассабис, соучредитель DeepMind, предсказал, что это произойдет в ближайшие пять-десять лет, а основатель Anthropic Дарио Амодей написал в прошлом году, что "мощный ИИ" может появиться уже в 2026 году.

Эксперты отрасли отмечают, что ИИ - это быстро развивающаяся технология, которая находится в стадии становления, поэтому многие компании по всему миру стремятся разработать свои собственные версии этой технологии. Но одна из причин, по которым эта идея волнует некоторых в Кремниевой долине, заключается в том, что она считается предшественником чего-то еще более продвинутого: искусственного сверхинтеллекта - технологии, превосходящей человеческий интеллект.

Еще в 1958 году стали обсуждать концепцию "сингулярности", которая описывает момент, когда компьютерный интеллект превзойдет человеческое понимание. В книге "Генезис 2024" исследуется идея сверхмощной технологии, которая становится настолько эффективной в принятии решений и руководстве, что человечество в конечном итоге полностью передаст ей контроль.

Сторонники новых технологий нейросетей с энтузиазмом рассказывают об их преимуществах. Они утверждают, что сверхумные ИИ помогут найти новые лекарства от смертельных болезней, решить проблему изменения климата и изобрести неиссякаемый источник чистой энергии. Предприниматель Илон Маск даже заявил, что сверхинтеллектуальный ИИ может положить начало эре "всеобщего высокого дохода". Однако есть и опасности, которые таит в себе эта технология. Например, она может быть захвачена террористами и использована в качестве оружия, или ИИ может решить, что человечество является причиной мировых проблем, и уничтожит его.

"Если что-то умнее нас, то мы должны держать это под контролем. Мы должны иметь возможность это отключить", - сказал Тим Бернерс-Ли, создатель Всемирной паутины.

И государства уже принимают защитные меры. В США, где базируются многие ведущие компании в области ИИ, президент Джо Байден в 2023 году подписал указ, обязывающий некоторые фирмы делиться результатами тестов безопасности с федеральным правительством. Но позднее вступивший в должность президента США Дональд Трамп отменил часть этого указа. В Великобритании два года назад был создан Институт безопасности ИИ - финансируемый государством исследовательский орган - для лучшего понимания рисков, связанных с передовым ИИ.-0-

В мире

13 октября 2025, 13:04

Некоторые лидеры IT-отрасли строят роскошные бункеры и готовятся к "катастрофическому событию"

Главное

- размещаются материалы рекламно-информационного характера.

- размещаются материалы рекламно-информационного характера.